Emergenz: Das Erwachen der Fähigkeiten

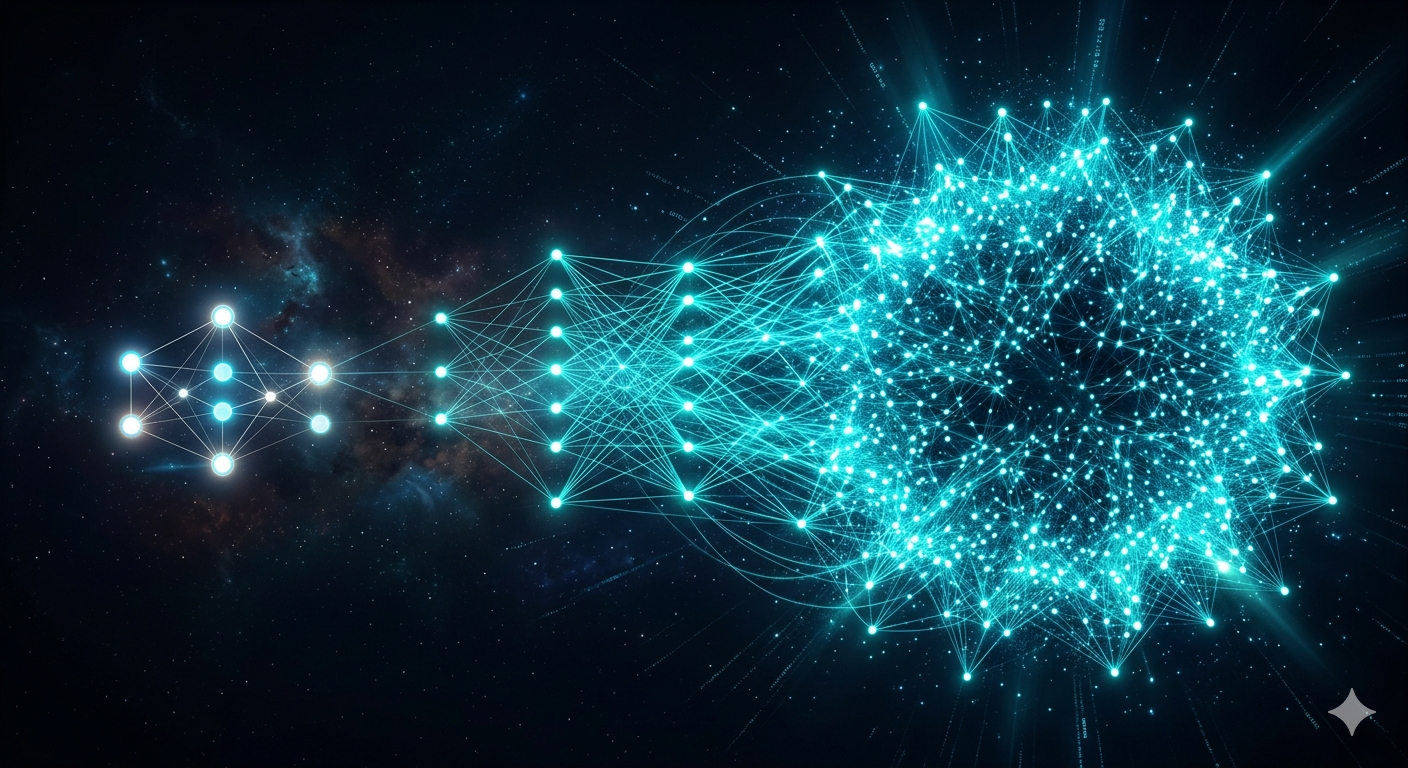

Wenn man ein neuronales Netz groß genug macht, passiert etwas Seltsames. Es lernt Dinge, die wir ihm nie beigebracht haben. Das nennen wir Emergenz.

Stell dir ein einzelnes Wassermolekül vor. Es ist nicht "nass". Erst wenn Milliarden davon zusammenkommen, entsteht die Eigenschaft "Nässe".

Wie Aristoteles sagte: "Das Ganze ist mehr als die Summe seiner Teile"!

Genauso verhält es sich mit KI: Ein riesiges Netz beginnt plötzlich, logische Rätsel zu lösen oder Programmiercode zu verstehen – einfach nur, weil es so viele Verbindungen hat.

Diese unerwarteten Fähigkeiten machen KI unglaublich nützlich. Aber Emergenz hat eine Kehrseite: Genau wie wir nicht vorhersehen können, wann eine KI plötzlich logisch denkt, können wir oft nicht vorhersehen, welche unerwünschten Verhaltensweisen oder Risiken auftreten, wenn Modelle wachsen. Hier sind reale historische Beispiele für dieses 'Erwachen' – von kurios bis alarmierend: